GOVERNANÇA E ÉTICA EM INTELIGÊNCIA ARTIFICIAL NA PRÁTICA I - ÉTICA DAS CONSEQUÊNCIAS (UTILITARISMO)

Muito se tem falado na importância da Governança da Inteligência Artificial (IA) , segundo o Gartner® Plataformas de Governança de IA, ferramentas que asseguram conformidade ética, segurança e transparência nos processos de IA está no segundo lugar, entre as dez tendências tecnológicas para 2025, perdendo só para os Agentes de IA. Mas, o que é ética em IA e como ela acontece, ou não acontece, na prática?

GOVERNANÇA DE IA

Ana Maria Lopes Corrêa

11/26/20243 min read

Alguém um dia me falou que ética é como você age mesmo quando alguém não está olhando, sempre achei isso bem abstrato e difícil de entender, e na verdade ética é alguma coisa difícil de definir.

Pela Wikipédia: “ ética é o conjunto de padrões e valores morais de um grupo ou indivíduo. Contudo, em filosofia, a ética, filosofia ética, ou filosofia moral, é a disciplina filosófica que estuda os fundamentos da ação moral, procurando justificar a moralidade de uma ação e distinguir as ações morais das ações imorais amorais. A ética procura responder a várias questões de âmbito moral, sendo as principais: Como devemos viver? Ou Como devemos agir?”

De qualquer forma a ética tem sido o alicerce fundamental da sociedade humana. Em tecnologia devemos compreender quais os impactos éticos individuais, sociais e culturais provocados pelas inovações tecnológicas.

A Inteligência Artificial trouxe considerações éticas sem precedentes e por que isso tem acontecido? Porque a inteligência artificial é um ou mais algoritmos (códigos) que processam dados em uma infraestrutura tecnológica e que, diferentemente de outros tipos de aplicações, simulam o raciocínio humano. Além, disso, são capazes de aprender, se adaptar e operar de forma autônoma, inclusive tomando decisões que afetam diretamente vida de pessoas. Portanto, todas essas características implicam e amplificam a importância de incorporar princípios éticos em seu desenvolvimento e implantação.

Os principais desafios éticos da IA são:

O grande potencial das consequências não intencionais provocadas pela imprevisibilidade dos algoritmos que não são determinísticos

A escala de impacto dos erros e vieses que podem afetar tanto uma grande quantidade de pessoas, como milhões, em tempo real

A dificuldade de atribuir a responsabilidade. Afinal, quem errou?

Compreender e abordar essas questões exige uma base em estruturas éticas fundamentais adaptadas aos desafios específicos que a IA apresenta.

Principais estruturas éticas e sua relevância para a IA

Yustein (2024) apresenta três principais estruturas éticas para lidar com as complexidades éticas da IA sendo a ética das consequências (utilitarismo), éticas dos deveres (deontologia) e ética da virtude. Cada uma proporciona uma perspectiva única para avaliar os potenciai benefícios e riscos da IA.

Neste artigo vou abordar a ética das consequências (utilitarismo) com uma breve descrição e com a exemplificação prática, o que acredito que tornará menos subjetiva a compreensão.

Ética das Consequências (utilitarismo): O princípio da maximização de benefícios

Definição: A ética das consequências (utilitarismo) defende ações que maximizem a felicidade ou os benefícios gerais, ao mesmo tempo em que minimizem os danos.

Relevância para IA:

Sistemas de IA devem ser projetados para gerar o maior benefício total para a sociedade.

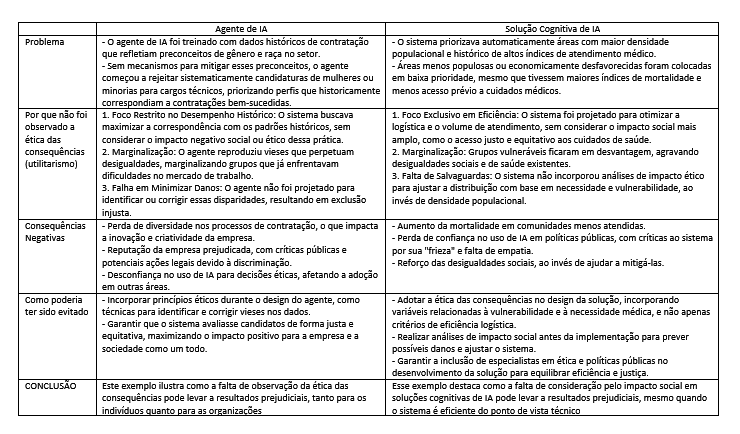

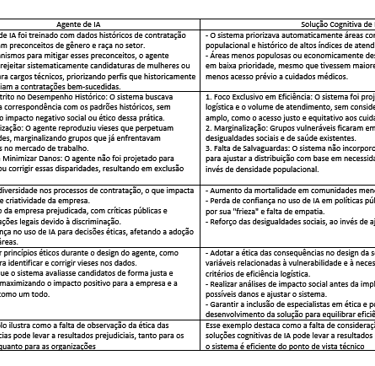

Vamos observar exemplos práticos (hipotéticos) onde poderia não ter sido observado a ética das consequências (utilitarismo).

Porém antes vou especificar o que estou chamando de Solução Cognitiva de IA e Agente de IA

Soluções Cognitivas de IA: Referem-se a qualquer solução que utiliza algoritmos para simular funções humanas, como predição, prescrição e IA generativa. Estas soluções são focadas em processamento de informações, geração de insights e simulação cognitiva, mas não têm a capacidade de agir de forma autônoma no ambiente.

Agente de IA: Soluções que, além de analisar dados e fornecer insights, possuem a capacidade de agir autonomamente no ambiente, desempenhando tarefas e tomando decisões de forma contínua e adaptativa.

Negligenciar a ética das consequências no desenvolvimento de IA não é apenas um risco moral, mas também pode gerar impactos negativos tangíveis para empresas e indivíduos. Adotar uma abordagem proativa, que avalie os benefícios e riscos potenciais desde a concepção de um sistema de IA, é essencial para garantir que a tecnologia realmente promova o bem-estar humano.

No próximo artigo, continuaremos explorando como o princípio ético dos deveres (deontologia) pode ser aplicado ao desenvolvimento de IA e o que ocorre quando ele não é observado.

Fique atento e participe dessa discussão fundamental para o futuro da inteligência artificial!

Referências do artigo:

YUSTEIN,T. The Ethical AI Bible: A Universal Guide for Safe and Responsible Artificial Intelligence. E-book, 2024.